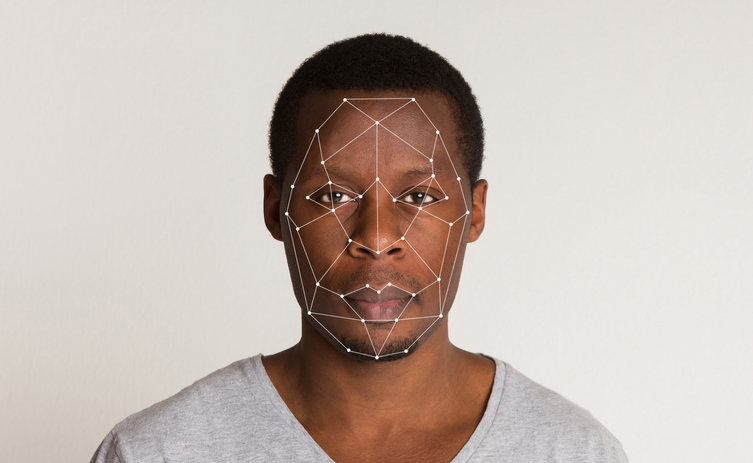

A Inteligência Artificial vem entregando para o mundo soluções que melhoram muito nossas vidas. Mas quando a pauta é o uso de reconhecimento facial no suporte à segurança pública, ela perde em simpatia para as populações pretas e aprofunda o racismo estrutural com consequências dramáticas – a depender, claro, de quem está sob sua mira.

O ano: 2022.

A intenção: um passeio despretensioso com esposa e filhos em uma festa junina que acontecia em Salvador (BA).

Poderia ser só uma pausa para o entretenimento enquanto o quentão reinava, a fogueira ardia e a família curtia a quadrilha. Mas para o pai – um homem negro que teve o rosto capturado por um equipamento com aplicação de IA –, o resultado foi a detenção por um roubo que ele não havia cometido.

O drama rendeu ao vigilante 26 dias privado de viver como uma pessoa livre — e o crime que levou aquele pai à prisão aconteceu em 2012, por outra pessoa. Na época, o verdadeiro criminoso foi preso em flagrante e usou o nome do trabalhador e as próprias digitais para se identificar. Com isso, um mandado de prisão foi inserido no sistema, com o nome do inocente.

A Secretaria de Segurança Pública da Bahia disse para o vigilante que “as câmeras constataram 95% de similaridade entre ele e o verdadeiro ladrão”. Mas nunca explicou como sua imagem foi parar no banco de dados do reconhecimento facial, já que ele nunca tinha cometido um crime.

A Defensoria Pública do estado, órgão que atuou no caso, destacou a falta de identificação pessoal do homem preso em 2012 – o que gerou a prisão injusta por meio do reconhecimento facial e a violação dos direitos do trabalhador.

Claro que esse fatídico dia jamais vai sair de sua memória e da memória de sua família.

Na Bahia, aliás, já foram investidos R$ 665 milhões nesse sistema, que já prendeu 1.011 pessoas e muitos inocentes.

Infelizmente, esses casos se somam a muitos outros na lista antipática promovida por equipamentos que, na verdade, já operam há bastante tempo.

Entre 2012 e 2020, foram registradas cerca de 90 prisões incorretas com o uso da tecnologia em nosso país, segundo dados do Colégio Nacional de Defensores Públicos Gerais (Condege). Destas, 79 foram de pessoas negras, enquanto as demais se dividiam entre pardas e brancas.

O levantamento, divulgado em 2021, mostra que 83% dos presos de forma injusta no Brasil são negros.

Na avaliação de especialistas, as falhas se devem ao uso de catálogos informais fundamentados no chamado…

Racismo algorítmico – reconhecimento facial e o lado não neutro da tecnologia

Estudos mostram que o reconhecimento facial em aeroportos pode identificar 90% dos negros como suspeitos e 100% das pessoas de olhos azuis como “acima de qualquer suspeita”.

Mas como pode até a tecnologia agir de forma racista?

Essa pergunta merece uma breve análise sobre o quadro de funcionários por trás da programação desses sistemas.

Recentemente, falamos por aqui que falta cor nos postos de trabalho das empresas responsáveis por inovações como essas. O total apagão de colaboradores pretos nesses setores é uma das respostas para o perverso racismo algorítmico.

A expressão, também conhecida como discriminação algorítmica ou preconceito algorítmico, coloca a Inteligência Artificial no centro quando a pauta é a perpetuação de preconceitos pelas vias da tecnologia – que reflete desigualdades históricas e o racismo estrutural da mesma forma como em nossa sociedade.

Mas como?

Se um algoritmo de aprendizado de máquina é treinado com base em dados que contêm desigualdades raciais, ele aprende a replicar esses padrões ao tomar decisões ou fazer recomendações.

Mas o racismo algorítmico não é uma característica intrínseca dos algoritmos em si. É a consequência do modo como eles são treinados e implementados. Na ponta, o principal problema é, na verdade, a legião de pessoas brancas que os programam – algoritmos são apenas códigos que cumprem as funções estabelecidas no pensamento computacional que será utilizado.

Pense que o programador é o maestro e que os algoritmos são todos os integrantes da orquestra. O primeiro conduz, enquanto músicos e musicistas executam. E quanto mais executam, com mais facilidade conseguem reproduzir o que lhes foi ensinado, afinal, passaram por uma série de treinamentos.

Esses sistemas funcionam assim. Cenário em que é descabido culpar as inovações, mas necessário pensar em alternativas urgentes para que a tecnologia não perpetue o racismo estrutural.

Na avaliação de Débora Oliveira Ramos, mestre em Políticas Sociais pela Universidade de Brasília, máquinas são máquinas, e se elas têm capacidade de matar, é porque alguém constrói tecnologias com esse propósito. “Isso esconde o verdadeiro perigo da Inteligência Artificial, que é a inteligência humana e objetivos estratégicos de uma comunidade científica que se alia aos propósitos da classe dominante utilizada para programar e definir as funções e impactos das inovações”, analisa.

Reconhecimento facial e racismo algorítmico: como combater a discriminação?

Especialistas pedem uma pausa no desenvolvimento de tecnologias com uso de IA. Apontam a necessidade de uma discussão ampla e aprofundada sobre o uso do reconhecimento facial no país e adiantam: essa responsabilidade não é apenas das empresas de tecnologia.

No combate ao racismo algorítmico, são necessárias as participações de agentes dos direitos humanos, representantes da sociedade civil e dos setores público e privado. Todas essas pontas, juntas, devem pensar em regulamentações claras para que a inovação não aprofunde o racismo estrutural – pauta tão cara às populações negras especialmente no setor da segurança pública: responsável por matar diariamente homens, mulheres e crianças negras sem que haja qualquer explicação.

Pesquisadores também pedem para que as companhias responsáveis pelo desenvolvimento das tecnologias de reconhecimento facial invistam em pesquisas e treinamentos que coloquem, no centro, toda a diversidade étnica da população brasileira.

Entre as medidas emergenciais, estão:

Promoção de equipes diversas: a contratação de pessoas pretas para os times de TI pode ajudar a evitar vieses inconscientes durante o desenvolvimento de inovações com aplicação de IA.

Auditoria de algoritmos: a promoção de auditorias regulares nos algoritmos para identificar e corrigir possíveis preconceitos. Isso pode envolver a revisão do código, dos conjuntos de dados e das saídas dos algoritmos para detectar e corrigir algum viés.

Aprimoramento dos conjuntos de dados: garantir que os conjuntos de novos dados usados para treinar os algoritmos representam a diversidade da população envolve coleta de dados mais abrangentes e a remoção de quaisquer vieses presentes nos dados existentes.

Testes éticos: investir na implementação de testes éticos durante o desenvolvimento dos algoritmos para avaliar como eles se comportam em diferentes grupos demográficos.

Educação e sensibilização: educar as equipes de desenvolvimento sobre o impacto social e ético dos algoritmos, destacando a importância do combate ao racismo algorítmico é um passo fundamental. Isso pode incluir treinamentos regulares sobre ética na Inteligência Artificial.

Quando a tecnologia imita a vida, é necessário reconhecer que eliminar completamente os vieses racistas dos algoritmos é um trabalho que impõe os mesmos desafios para as populações pretas no simples fato de existirem.

Por isso pedimos para que você exerça seu papel na cidadania: exija dos seus representantes políticos ações para o combate ao racismo, em todas as suas formas.

E não se esqueça! Enquanto negros ocuparem apenas um décimo das cadeiras do Poder Legislativo do Brasil, as pautas em defesa dos interesses do grupo poderão continuar sendo adiadas para amanhã. Só que esse amanhã pode ser muito tarde, especialmente para as mães que perdem filhos inocentes todos os dias para as falhas e truculências cometidas pela segurança pública do nosso país.